GPU高速化と環境制御。Colab「動かない」を解決する術|入門⑤

ー Information ー

- この記事はこんな人向け: Google Colabの基本操作を終え、より高度なAI処理やトラブルへの対応力を身につけたいと考えている方。

- この記事で学べること: GPUによる処理の高速化設定と、エラー発生時に冷静に対処するためのシステム操作術。

- 目安読了時間: 約4分

AIを自在に操る第一歩。マシンスペックを使いこなしエラーをねじ伏せる技術

Colab学習シリーズも第4回、カリキュラムはいよいよ終盤です。

前回はGoogleドライブの連携について学びました。

今回は「マシンスペックの活用とトラブル対応」という、一歩踏み込んだ上級編に挑みます。

これまではGoogleドライブとの連携など「外側」の仕組みを学びましたが、ここからは「画像生成や音声認識などの高度なAI処理」を支える中身の話です。

単にコードを動かすだけでなく、エラーが起きた際に自力で復旧できる「エラーに強いエンジニア」への入り口に立ちましょう。

この記事は、全6回で構成される『Google Colab の基礎中の基礎【完全初心者向け】』シリーズの第5回目です。

全体の流れを確認したい方は『ここをクリック』してください。

【上級編】マシンスペックの活用とトラブル対応

カリキュラムで提示された目標はこちらを開いてご覧ください

このパートを習得すると、Colabの真価である「高性能なAI(画像生成や大規模言語モデル)」を動かせるようになります。また、エラーが起きたときに自分で復旧できる力が身につきます。

1. ランタイムの変更(GPU/TPU)

なぜこれが必要か?

通常の状態(CPU)は、事務処理は得意ですが、AIの計算(画像処理など)は非常に遅いです。GPUは「AI専用の加速装置」のようなものです。これをオンにしないと、画像生成に何十分もかかってしまいます。

操作手順:

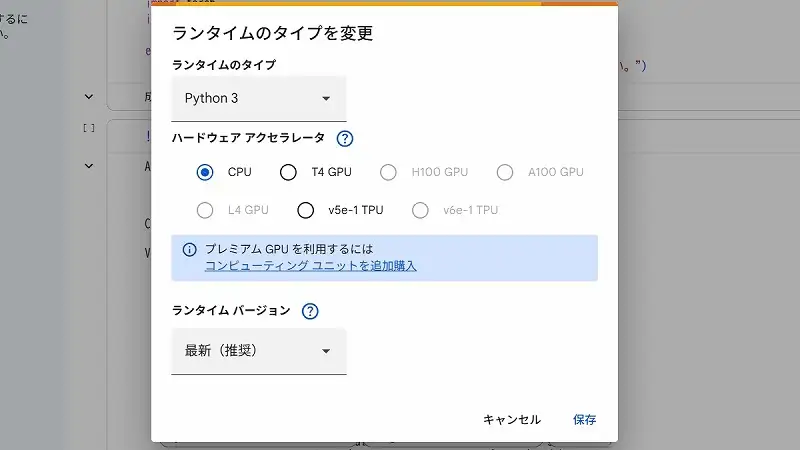

- Colabの上部メニュー「ランタイム」をクリック。

- 「ランタイムのタイプを変更」を選択。

- 「ハードウェア アクセラレータ」の項目で 「T4 GPU」 を選択し、「保存」を押す。

確認ポイント:

右上の接続ステータスが一度「初期化中」になり、再接続されます。これで加速装置が搭載された状態になりました。

※無料版では使用時間に制限があるため、使い終わったら必ず「接続を解除」するのがマナー(そして制限回避のコツ)です。

2. コマンドライン操作(システムへの直接命令)

なぜこれが必要か?

Pythonコードだけでなく、Colabが動いている裏側のコンピュータ(Linux)に直接命令を出せると、ファイルの場所確認やGPUの状態確認がスムーズになります。先頭に ! をつけるのがルールです。

試すべきコマンド(コードセルに入力して実行してください):

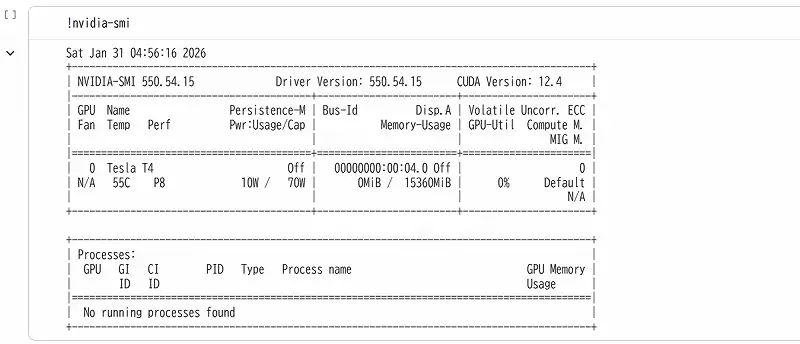

- GPUの健康診断:codePython

!nvidia-smi解説: これを実行して表のようなものが表示されればGPUが正しく動いています。右側の「Memory-Usage」を見れば、AIがどれくらいメモリを食っているかがわかります。 - 今どこにいるか確認:codePython

!pwd解説: "Print Working Directory"の略です。通常は /content と表示されます。 - ファイル一覧を見る:codePython

!ls -l解説: 今いる場所にあるファイルを表示します。アップロードしたはずの画像が見当たらない時、これで確認します。

3. セッション管理と再起動(トラブルシューティング)

なぜこれが必要か?

AIを動かしていると、「メモリ不足」で固まったり、変数がごちゃごちゃになってエラーが消えなくなったりします。その時の「直し方」には2段階あります。

レベル1:ランタイムを再起動(ソフトリセット)

- 操作: メニュー「ランタイム」→「セッションを再起動」

- 効果: 変数(x = 10など)やメモリの中身は消えますが、アップロードしたファイルやインストールしたライブラリは残ります。

- 使い所: コードの挙動がおかしい時、とりあえずこれを試します。

レベル2:ランタイムの接続解除と削除(ハードリセット)

使い所: どうやってもエラーが直らない時や、GPUの使用時間をリセットしたい時(完全にゼロにはなりませんが、セッションを切るために使います)。

操作: メニュー「ランタイム」→「ランタイムを接続解除して削除」

効果: 全て消えます。 工場出荷状態に戻ります。ファイルも消えるので再アップロードが必要です。

上級編の実践課題

以下のコードをColabのセルにコピペして実行し、GPUが認識されているか確認してみましょう。

# GPUが使えるか確認するコマンド

!nvidia-smi

# 完了したら、Pythonからも確認してみましょう

import torch

if torch.cuda.is_available():

print("成功です!GPUが認識されています。AIを高速で動かせます。")

else:

print("GPUが認識されていません。「ランタイムのタイプを変更」を確認してください。")

これができれば、あなたはもう「ただコードをコピペする人」ではなく、「環境を制御できるエンジニア」の入り口に立っています。

AI専用の「加速装置」を起動せよ!T4 GPUで画像生成を爆速にする方法

事務処理が得意なCPUに対し、AIの複雑な計算を一手に引き受けるのが「GPU」です。

これをオンにするか否かで、画像生成にかかる時間は「数十分」から「数十秒」へと劇的に変わります。

【設定手順】

- メニューの「ランタイム」から「ランタイムのタイプを変更」を選択。

- ハードウェア アクセラレータで「T4 GPU」を選んで保存。

- ステータスが「初期化中」を経て再接続されれば、加速装置の搭載完了です。

※無料版は使用時間に限りがあるため、使い終わったら「接続を解除」してリソースを節約するのが、スマートな利用のコツです。

「!」一つでシステムと対話する。開発をスムーズにする魔法のコマンド3選

Pythonのコードだけでなく、Colabが動いている裏側のコンピュータ(Linux)へ直接命令を出すスキルも重要です。

先頭に ! をつけるだけで、システムの深部を覗き見ることができます。

- GPUの健康診断:

!nvidia-smiGPUが正しく動いているか、メモリをどれくらい消費しているかを確認できます。

- 現在地の確認:

!pwd今自分がどのフォルダにいるかを表示します。通常は/content(作業用デスクトップ)にいるはずです。

- ファイル一覧の表示:

!ls -l「ファイルが見当たらない」という時に使用します。詳細モードで表示することで、中身がフォルダなのかファイルなのかも一目瞭然です。

【要注意】メモリ不足で固まったら?生存率を上げる2段階のリセット術

AIを動かしていると、メモリ不足でフリーズしたり、変数が複雑に絡み合ってエラーが消えなくなったりすることがあります。

そんな時に命綱となるのが「2つのリセット法」です。

1. セッションの再起動(ソフトリセット)

「ランタイム」→「セッションを再起動」。変数の中身は消えますが、アップロードしたファイルやインストールしたライブラリは維持されます。挙動が怪しい時の第一選択肢です。

2. 接続解除と削除(ハードリセット)

「ランタイム」→「ランタイムを接続解除して削除」。こちらは工場出荷状態に戻す操作です。ファイルも全て消去されるため、最終手段として使います。

【ここは盲点だった!】初心者がハマりやすい「コマンドが見つからない」の罠

私が実際にやってしまった失敗が、GPU設定を忘れたまま !nvidia-smi を実行したことでした。

結果は、エラー。

当然ですが、このコマンドは「NVIDIA製のGPU」が物理的に認識されていないと動きません。

コンピュータに「ないものを見せろ」と言っても、「そんなものはない(command not found)」と返されるだけなのです。

「まずはハードウェア(GPU)を有効にする」。

この大前提を忘れると、どんなに正しいコマンドも無力化してしまいます。

GPU設定をしたので再び!nvidia-smi を実行すると、

ちゃんと表が出てきました。

これで高性能なAIを使えているということですね。

自分の手で「AIが動く場所」をコントロールする快感

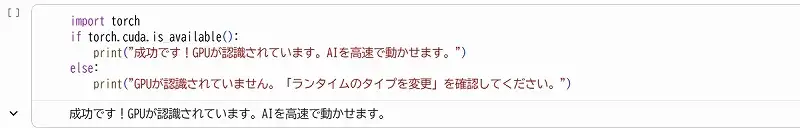

最後に、Python側からもGPUが認識されているかを確認しましょう。

以下のコードをColabのセルにコピペして実行

# GPUが使えるか確認するコマンド

!nvidia-smi

# 完了したら、Pythonからも確認してみましょう

import torch

if torch.cuda.is_available():

print("成功です!GPUが認識されています。AIを高速で動かせます。")

else:

print("GPUが認識されていません。「ランタイムのタイプを変更」を確認してください。")

「成功です!」と表示されました。

これでもう「ただコードを借りてくる人」ではありません。

実行環境を自らの意思で制御できるエンジニアの仲間入りです。

まとめ

まだ高度な処理をフル活用する場面は少ないかもしれませんが、この「裏側の仕組み」を知っているだけで、トラブル時の安心感は格段に変わります。

次回はいよいよ最終回。この環境を武器に、さらなる応用へと突き進みましょう。

Google Colabを基礎から学びたい方は、こちらのまとめページから順番に読み進めるのが一番の近道です。